身为长期留意人工智能发展情形的从业者,我察觉到BabyQ这类早期对话模型得以现身,这标明着处在技术探索的初级时期。它们虽说并非完备,然而却给我们对于人机交互界限的认知,提供了珍贵的实践事例。当下,我打算从技术演变的角度,讲讲对于这类模型的客观看法。

名为BabyQ的早期所代表的模型,其核心价值是对基础交互逻辑进行验证,在实际运用当中,它可以处理简单的问答以及指令,可是在面对复杂语境或者需要深度理解的情况的时候,它的局限性就会明显地显现出来,这对我们起到了提醒的作用,技术发展要按照一定的顺序逐渐推进,任何创新都不能缺少扎实的基础积累。

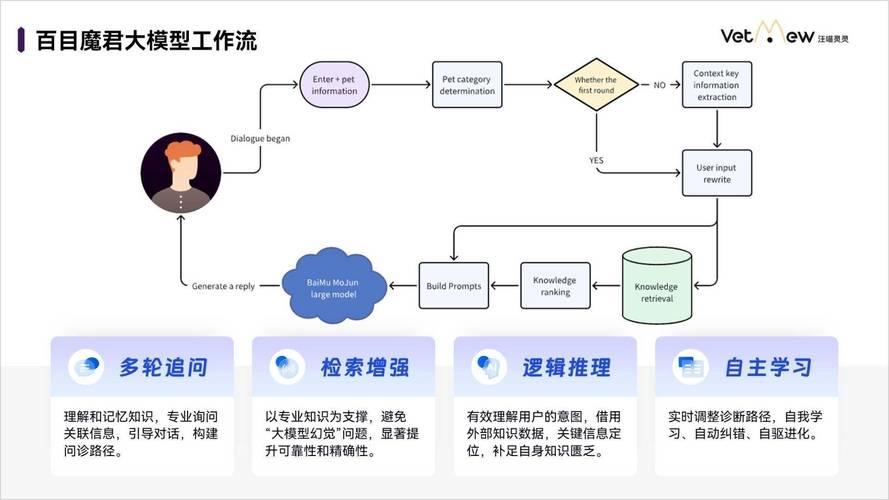

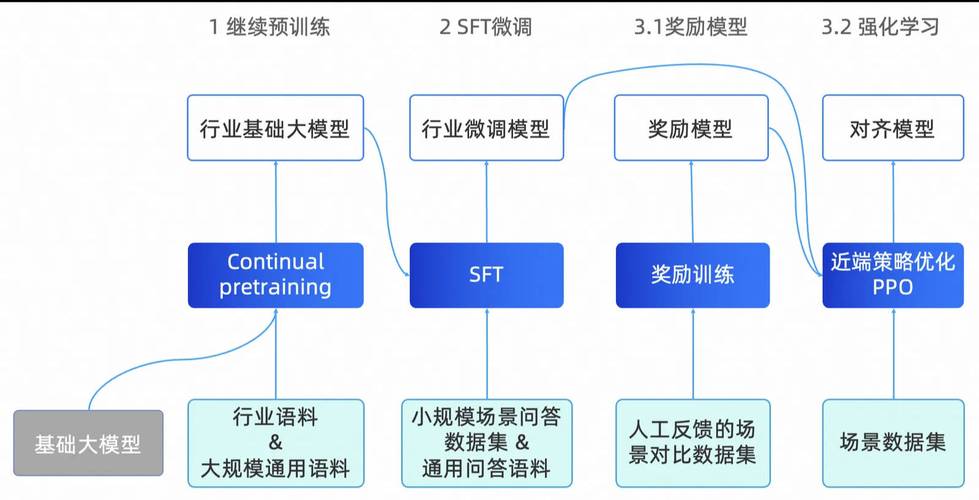

就技术架构而言,这类模型常常基于相对简易的规则以及有限的语料库。和当下基于大语言模型的系统相比较,它在语义理解方面,在上下文关联方面,在知识广度方面,均存在显著差距。而这种技术代差正好表明了人工智能领域近些年来所获取的突破性进展。

让人值得去思考的是,早期模型相关的伦理安全机制相对而言是比较薄弱的,在开放的网络环境当中,怎样去确保 AI 系统所输出的内容符合社会规范,这一直以来都是行业需要持续不断去攻克的难题,而攻克这一难题需要开发者、研究机构以及监管部门的共同予以努力。

您于早期AI系统使用期间碰到过哪些令人印象深刻的情形呢,对于当前AI技术的迅猛发展又持有怎样的看法呀,欢迎分享您的见解 。